Doomの自動プレイが可能になったNDP200 AIプロセッサーの昨今

ASCII.jp / 2023年2月27日 12時0分

Syntiantは連載703回で取り上げた。この時はNDP100世代を中心に説明したわけだが、最後でSyntiant 2コアをベースにしたNDP200が開発を完了し、2021年9月に発表されたという話をしている。今年のISSCCでは、このNDP200の詳細が出てきたので紹介したい。

音声認識に特化したNDP100では 性能が足りない用途に向けた後継チップ

連載703回でも説明したが、Syntiantの最初の製品であるNDP100世代は、音声認識にターゲットを絞り、しかもメモリー兼演算素子としてNORフラッシュではなくキャパシターを使ったという思い切りの良さが特徴的な製品だ。

それもあってすでにそれなりの数のチップを出荷するとともに、Amazon Alexaの認証を取得するなど音声の市場をうまくつかむことに成功している。

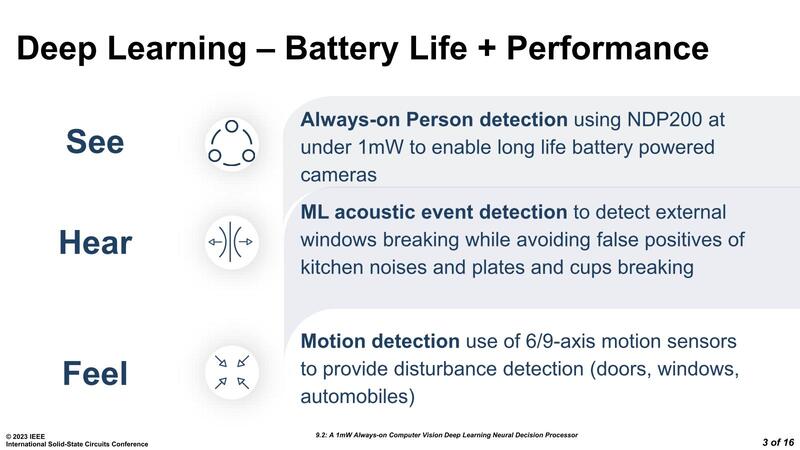

これに続くのがNDP200で、もう少し汎用的な用途を狙ったものであるが、その「汎用的」もわりとターゲットを絞ったものであったことは好感が持てる。

映像で言えば、1mW未満の消費電力での人物検出(これはインテルのGNAと同じターゲットだ)や、もっと高機能な音声検出(窓ガラスの破壊音と、キッチンでコップが割れた音をきちんと区別して前者だけを通知できる)、6/9軸センサーの検出などだ。

6/9軸センサーの場合、個々の軸からのセンサー信号そのものが増えるわけではないが、軸の数だけデータが増えるので、同時に扱おうとするとそれだけの演算性能が必要になる。NDP100や120では、軸の数だけチップを用意する必要がある。つまりNDP200は、NDP100シリーズ単体では性能が足りない用途に向けた製品であり、ただそれはNDP100シリーズで開拓した市場の延長にあるわけだ。

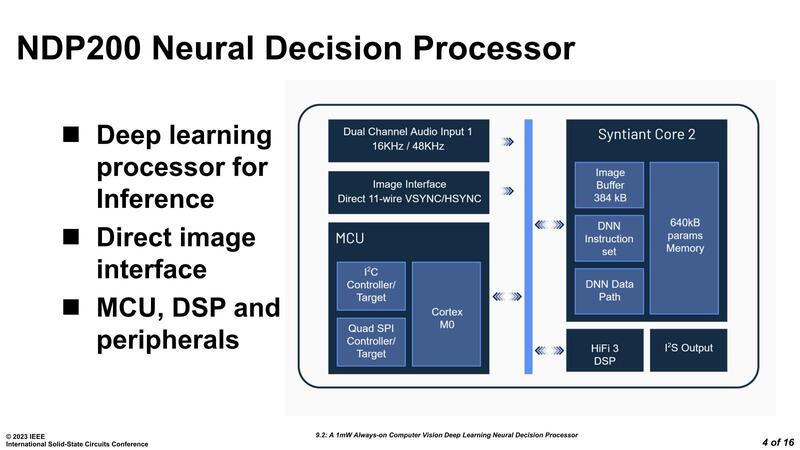

そんなNDP200であるが、構造は下の画像のとおり。画像処理を意識して、直接イメージ・インターフェースを搭載しているのが新しい。加えてHiFi 3 DSPとI2S出力を搭載しているのも特徴である。これは音声処理に向けたもので、こうした用途に向けた機能強化も怠らない。

先の「ガラスの破壊音とコップが割れた音の区別」にしても、もちろん全部をAIで処理することもできるが、適切な音声のフィルタリングを事前に行なうことでより精度を上げたり、AI処理の負荷を減らしたりできる。HiFi 3 DSPはこうした用途に最適である。

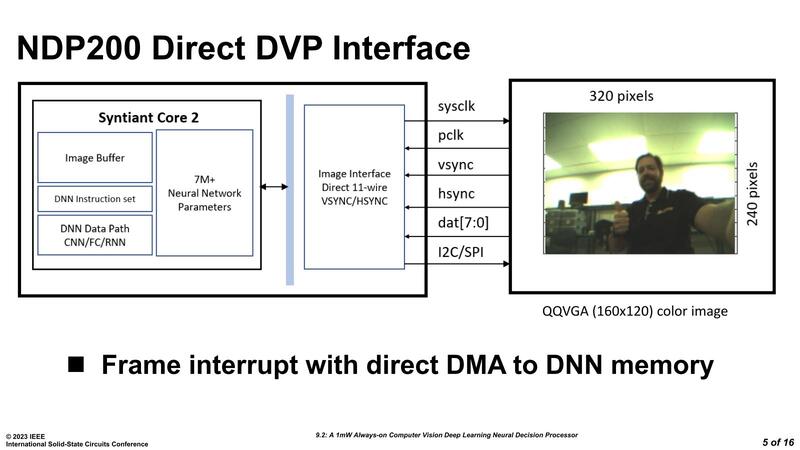

もう1つおもしろいのは画像のI/Fである。昨今カメラのI/FといえばMIPI CSI-2が広範に利用されつつある。CSI-2はいわばデジタルのカメラI/Fであるのだが、NDP200はあえてDirect DVP I/Fを搭載している。

ごらんのとおり、8bitのPixelデータとVsync/Hsync(垂直/水平同期信号)を送り出す方式だ。産業用カメラはほぼCSI-2が普通で、この11wire(カメラから送り出す信号線は11本の意味)の方式はもっと安いカメラでしか使われない。逆に言えば、そうした安いカメラを使うような用途がNDP200のターゲットということになる。

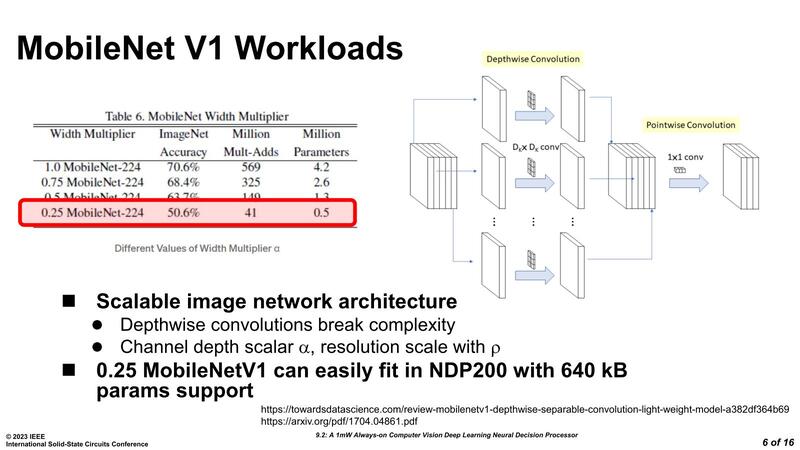

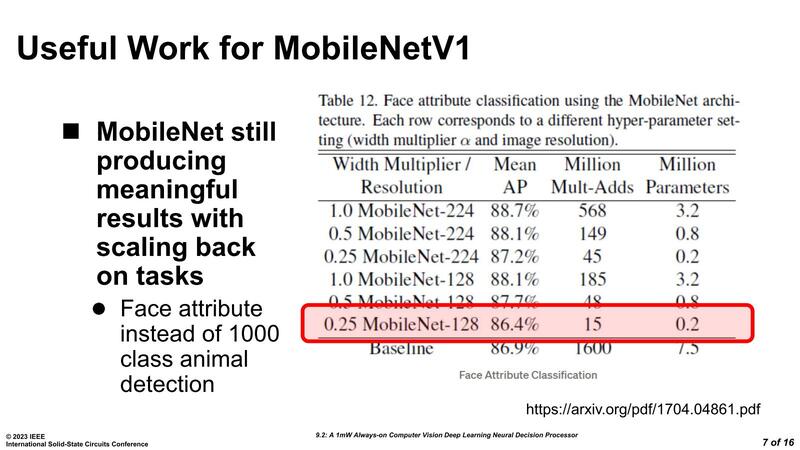

映像を扱う場合のネットワークであるが、2018年の研究で、MobileNetV1を実装する際にwidth multiplier(要するに画像の幅である)であるαというパラメーターを実装することで、ネットワーク規模を大幅に抑えられるという話は知られている。

ImageNet V1は224×224ピクセルがデフォルトの画像サイズだが、α=0.25というのは画像サイズが56×56ピクセルまで落ちることになる。ただここまで落とすと、パラメーターの数は500K個に抑えられる。パラメーターは当然8bitなので、パラメーターの保持には500KBが必要と言う計算になる。

NDP200はパラメーター用に640KBのSRAMを内蔵しているので、0.25ImageNet V1を動かすのであれば、外部のメモリーを一切利用せずに内部のSRAMだけで処理が完結することになる。

ただここまで解像度を落としてどの程度の精度で処理ができるのか? という話だがこれも先行研究があり、入力画像を1000クラスの動物に分類するという処理で86.4%の精度を実現したとしている。顔検出であれば十分な精度としていいだろう。

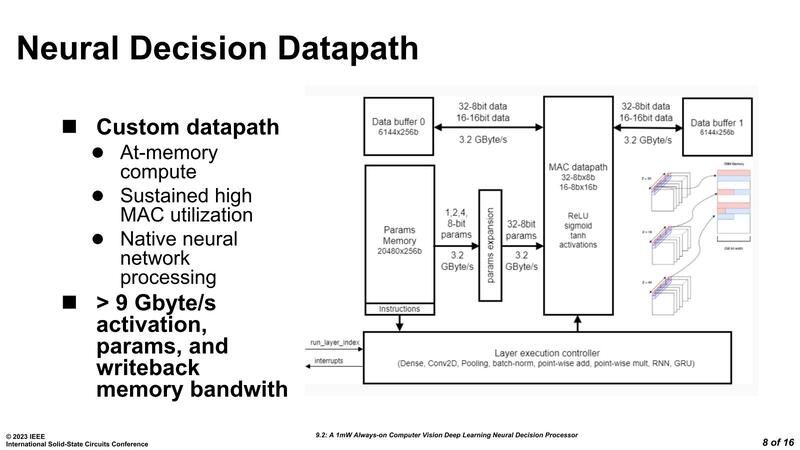

下の画像が実際のSyntiant 2コアの構成である。

肝心のプロセッサーエレメントというか、Syntiant風に言うならMACユニットの数そのものは公開されていないが、MACデータパスブロックには2つのデータバッファ(それぞれ192KB)と640KBのパラメーターバッファがそれぞれ3.2GB/秒の帯域で接続され、最大で9.6GB/秒の帯域を利用できるとする。

これ、AIプロセッサーの内部メモリー帯域としてはかなり低い方の部類に入るのだが、消費電力が1mW台のプロセッサーということを考えればかなり高い帯域なのがわかる。1W相当まで動作周波数を上げたら、9.6TB/秒におよぶ計算になるからだ。

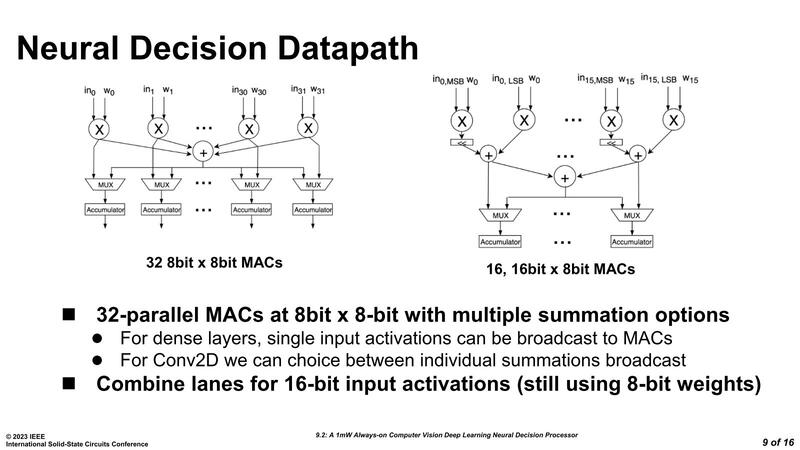

このMACユニットは、8bitなら32個、16bitなら16個の同時演算が可能になっている。もっともこれで縦幅が32個なのか? というとそれはおそらく早計で、これが縦横に複数個並んでいると考えるべきだと思われる。

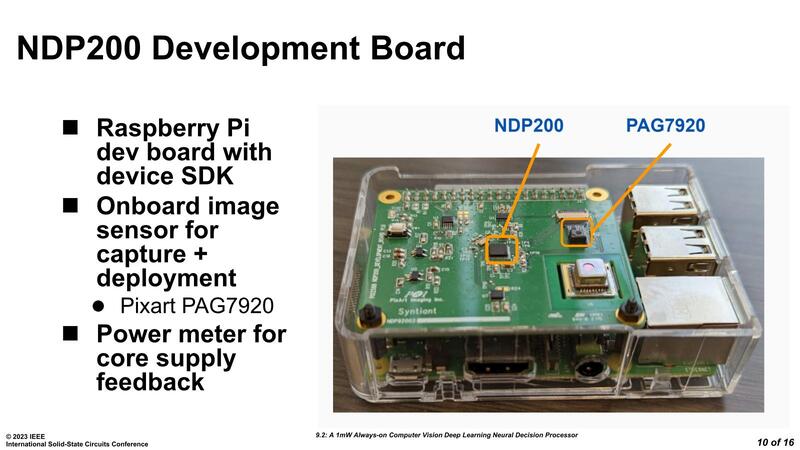

すでにこのNDP200を搭載した開発ボードも完成しているそうで、Raspberry Piの上にこれを乗せて利用できる格好だ。

AIにDoomをプレイさせる トレーニングは3日で完了

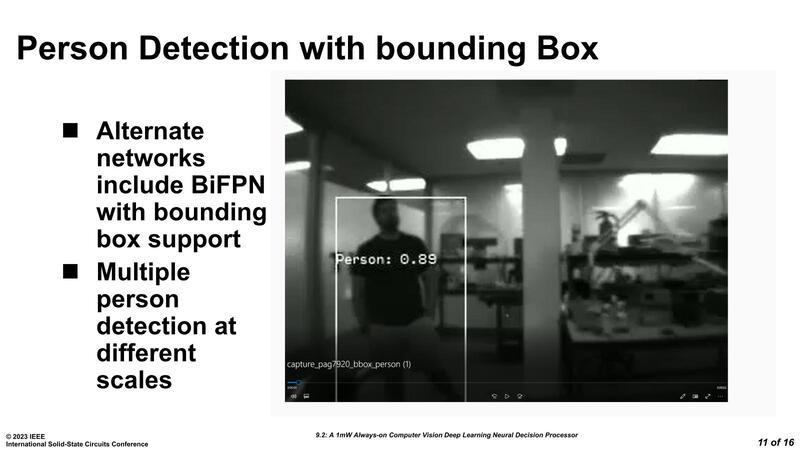

実際に人物検出のデモなども行なわれたが、実はこの程度のことであれば他のAIプロセッサーでも当然可能なわけで、性能を示すためにはあまり役に立たない。

Syntiantもそう思ったのだろうか? なかなかユニークなデモを行なってくれた。Doomをプレイさせるというものだ。下の動画の8分57秒あたりから説明がある。

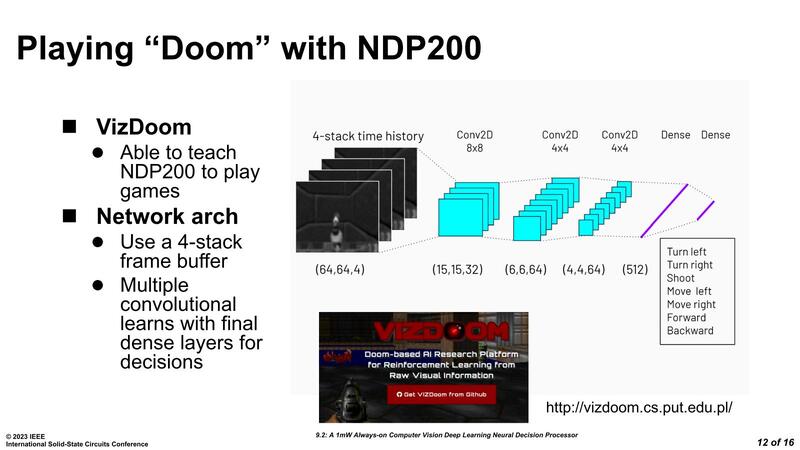

Doomといっても本物のDoomではなく、VizDoomを利用している。VizDoomそのものは2016年から提供されている、AIで操作させるプレイヤーのため開発されたDOOMのプラットフォームであり、プレイヤーは画面の情報「だけ」を利用して操作することが許されている。このVizDoomをNDP200に移植した。

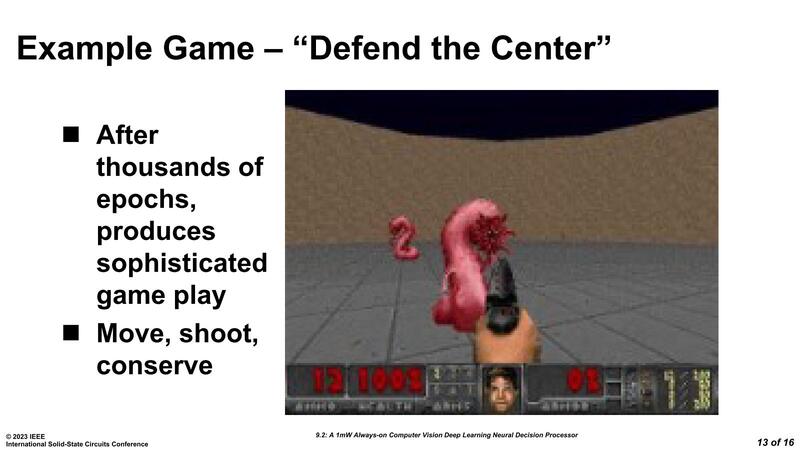

まず最初は円形の部屋のど真ん中に位置し、そこで数千回ものプレイを学習して、モンスターを撃ち殺すことと360度の回転を学習。その後に移動することを学習したという。

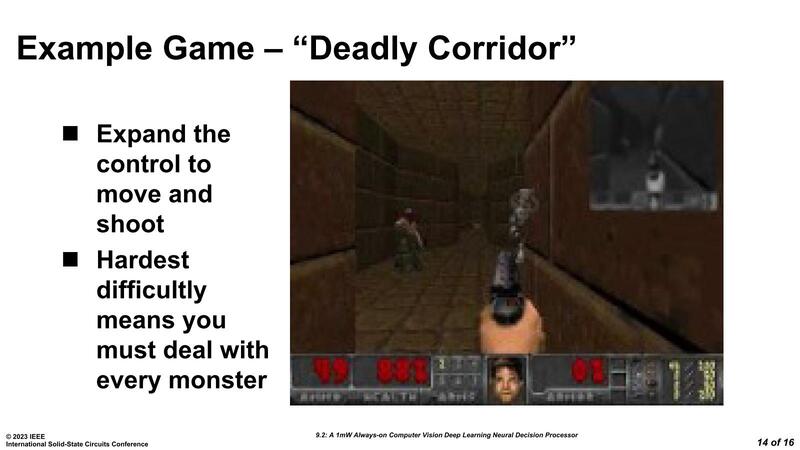

ここである程度の学習を終えた後で、もう少し複雑な迷路内のプレイに移行し、こちらでのトレーニングを完了するのに3日ほどかかったという。

ただ、こんなローエンド向けのチップでたったの3日でトレーニングが完了した、というあたりからもNDP200の性能の高さをうかがい知ることができる。

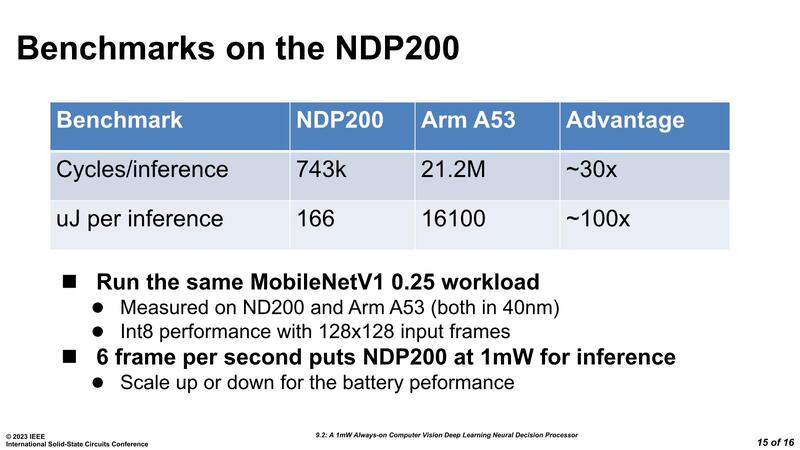

もう少し定量的なベンチマークとしては、ArmのCortex-A53コアと比較した場合の数値がある。それが下の画像だ。0.25 MobileNetV1の処理性能は30倍以上、性能効率は100倍にもおよぶとしている。

実際の使い方としては、それこそ冒頭で書いたように人物検出などであれば端的に言えば1~2fpsでも普通は足りるわけで、6fps(つまり0.1秒ごとに検出)の場合の消費電力は1mWに過ぎないとされる。これは相当に低い数字であることがわかるだろう。

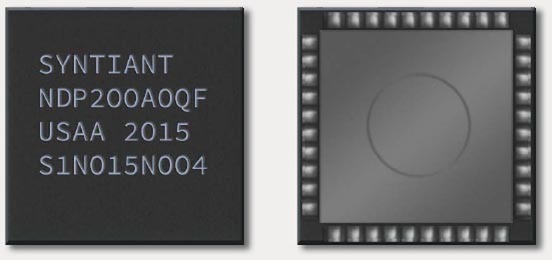

すでにNDP200は評価ボードだけでなくチップでのサンプル出荷も開始されている。製品ページには40ピンのQFP(Quad Flat Package:リード線が四辺に出ている平面実装パッケージ)とあり、複数のパッケージオプションがありそうである。

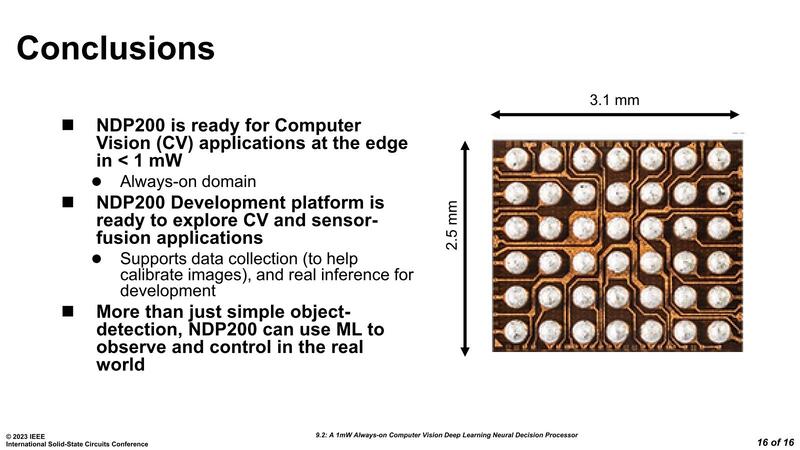

メモリー搭載量の増加などもあって若干NDP100シリーズよりは大型化しているが、それでも十分小さい(7.8mm2)サイズであり、組み込み機器への導入も容易だろう。引き続きSyntiantは、こうしたEndpoint AI向けのソリューションに注力している、ということがよくわかる発表であった。

この記事に関連するニュース

-

業界トップクラスの低ノイズ 民生・産業機器用リニアホールIC 「S-5611A」を発売

@Press / 2024年11月26日 10時0分

-

小型AIスマートカメラモジュール『SCMシリーズ』をリリース

共同通信PRワイヤー / 2024年11月14日 16時0分

-

Metaが自社開発したAI推論用アクセラレーターMTIA v2 Hot Chips 2024で注目を浴びたオモシロCPU

ASCII.jp / 2024年11月4日 12時0分

-

Appleはなぜ“Mac週間”でラインアップを更新したのか 透けるIntelチップからのリプレースとAIへのこだわり

ITmedia PC USER / 2024年10月31日 12時5分

-

超小型で高性能な「Mac mini」と超広角カメラ搭載の「iMac」――新モデルから見えるAppleの「デスクトップMac」戦略

ITmedia PC USER / 2024年10月30日 15時30分

ランキング

-

1NHKのネット受信契約(案)が“ダークパターン”過ぎて見過ごせない件(前編) NHKの見解は?

ITmedia NEWS / 2024年11月28日 19時9分

-

2どうする? 大学生用パソコンの選び方 「4年通しよりも2年で買い替え」がオススメな理由

ITmedia NEWS / 2024年11月28日 13時26分

-

3「ミリ波対応スマホ」の値引き規制緩和で感じた疑問 スマホ購入の決め手にはならず?

ITmedia Mobile / 2024年11月28日 18時13分

-

4えっ、プレステ2のゲーム高すぎ!? ここにきて中古ソフトが高騰している納得のワケ

マグミクス / 2024年11月28日 21時45分

-

5松屋が“店内持ち込み”で公式見解→解釈めぐり賛否 「何と言うサービス精神」「バレなきゃいいのか……?」

ねとらぼ / 2024年11月28日 20時2分

記事ミッション中・・・

記事にリアクションする

![]()

記事ミッション中・・・

記事にリアクションする

エラーが発生しました

ページを再読み込みして

ください