生成AIはいずれ創造性を獲得する。そのときクリエイターに価値はある?

ASCII.jp / 2023年12月17日 15時0分

〈前編はこちら〉

ユーザーからの反発を企業はどう受け止めるべきか?

AI関連サービス普及によって、マンガ・アニメの領域などさまざまな界隈で引き起こされているAIと倫理の問題について、注目の書籍『AIの倫理リスクをどうとらえるか:実装のための考え方』リード・ブラックマン(白揚社)の翻訳者・小林啓倫さんにうかがっていく。

◆

―― では前回の終わり際の話題からいきましょう。

倫理をストラクチャーとコンテンツに整理し、そのうえで、実効性はあっても何をしたいのか不明確になりがちなストラクチャーではなく、AIで何をしたいのかというコンテンツから定めていくことが重要だとうかがいました。

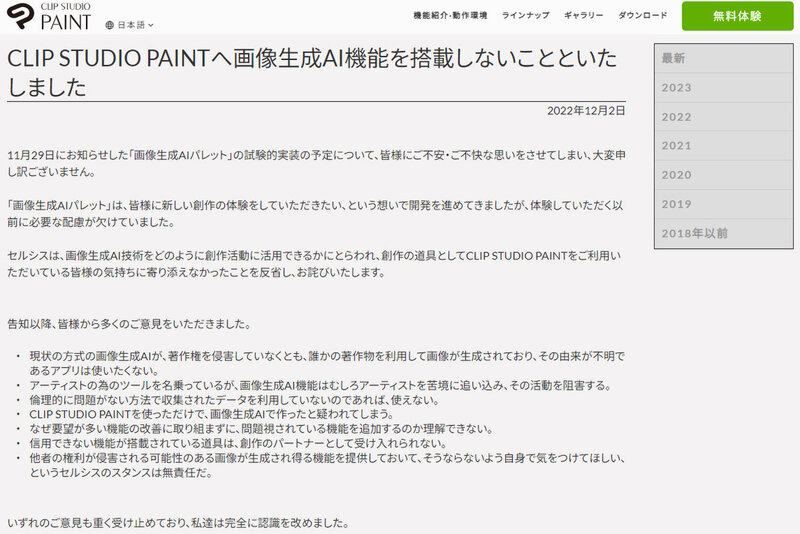

しかしながら、たとえばCLIP STUDIO PAINTは「クリエイターの利益をもたらすこと」を目指して画像生成AIパレットの搭載を進めた結果、ユーザーから想定外の反発を受けることになりました。コンテンツをどう定めるのか、ユーザーとの共通の価値観を持つことも難易度の高い作業と言えるかもしれません。どうすれば良いのでしょうか?

小林 基本的には1つ1つブレイクダウン(細分化)していくしかありません。本書ではAIにおける倫理の中核的なものとして3つを掲げています。1つめはバイアス、2つめは説明可能性、そして最後にプライバシーです。

説明可能性では、AIが下した(生成した)何らかの結論を、どうしてそういう結論に至ったかを人間の誰かが説明できないといけない、としています。よくわからないけれどそうなった、というブラックボックスであってはいけないというわけです。では、具体的にどういうことなのか。

たとえば優秀な医療AIがレントゲン写真から100%に近い確率で癌を見つけられるとします。でも、その医療AIがどんな理由で判断したのかというプロセスがブラックボックスになっているとしたら、採用すべきか否かというケースが本書では紹介されています。

もちろん患者の側からすれば癌が見つけられるのであれば、説明可能性はさておき利用したい、となるはずです。医師も人命を守るためには精度が最優先となるでしょう。

でも、そうは言っても万が一誤診だと困ります。したがって、サービス提供側としてはやはり説明可能性を担保したい。AIにおいては多くの場合、結論に至るプロセスの説明可能性と精度はトレードオフの関係にあります。さて、どちらを採用するべきか、ということになります。

また金融系のAIにおいてローン審査を実施するような場合、貸し倒れを高い精度で避けることができるという意味で銀行側にとってはとてもありがたい仕組みとなりますが、顧客にとっては納得できないケースも出てきます。この場合も多少AIの精度は落ちても顧客にある程度の説明、たとえば転職回数が多いからです、といった話ができたほうが良いでしょう。

つまり、説明可能性という倫理基準1つとっても、自分たちがどんなサービスを提供しているかによって、それぞれどんな形になれば基準を満たすかは変わってきます。バイアスやプライバシーについても同様で、本書では1つ1つブレイクダウン(細分化)して検討されています。

■Amazon.co.jpで購入

AIの倫理リスクをどうとらえるかリード・ブラックマン、小林啓倫白揚社

―― 現在、画像や音楽系の生成AIサービスに対しても、「何を学習して、どのように結果を生成したのか明らかにせよ」と説明を迫る動きが続いています。顧客、それもどこまでを顧客とするかも含めて事業者がどのようにコミュニケーションを取り、どこまで説明をするべきなのか、模索を続けなければならない、ということになりますね。

小林 著者のブラックマンは説明についてもおもしろい表現を用いていて、「人間による説明」と「機械による説明」と言い方をしています。たとえば、画像認識AIで画像に写っているものが犬か猫かを判別する場合に、機械がやっていることは膨大なピクセル(画素)の中から「この部分が赤だと犬である可能性が高い」といったことをやっているわけです。

これが機械による説明としてのブレイクダウンということになります。でも、我々人間が求めている説明可能性というのはそのレベルじゃないんですよね。先ほどのローン審査であれば、融資担当者がプリントアウトされた紙を持ってきて、対面でAIの判断について言葉で説明する、といった具合にもっとブレイクダウンされていなければなりません。

そこまで具体的なプロセスに落とし込んで初めて倫理基準を満たすことになるわけです。もちろん、本書に書かれた通りにすれば良いということではなく、そのプロセスを定めるための議論ができるレベルまでクリアになるようブレイクダウンすることが重要なのです。

ユーザーだって間違えるし、倫理的に常に正しいわけでもない

―― 医療AIのように、命を守るために分析過程の説明可能性よりも精度を優先しているのだ、ということが患者(顧客)に「説明」できるレベルにまで議論を重ね、組織としての対応方針を定めることが重要なわけですね。

たとえばCLIP STUDIO PAINTのイラスト生成AIならば「優先事項は生産性」という方針が定まっていれば、ユーザーの批判も受け止めたうえで機能を実装出来ていたかもしれないのでしょうか? 「皆様に新しい創作の体験をしていただきたい」という想いだけでは倫理のストラクチャーとしては弱かったと。

小林 そうですね。本書のなかで「つまり顧客の意見を聞けば良いの?」という問いかけがあったのを思い出しますね。でも、顧客だって間違えることはあるし、倫理的に常に正しいわけでもありません。

もう少し原理・原則に立ち返って「説明可能性を実現するというのはどういうことなのか」を確認する必要があります。もちろん顧客の意見には耳を傾けつつ、自分たちが実現したいこととのバランスを踏まえて、「私たちはこうします」という方針を打ち出していく。

たとえば「要望が多い機能の改善に取り組まず、問題視されている機能を追加するのか」という意見が紹介されていますが、企業は必ずしも顧客の要望にすべて応える必要はありません。むしろ、新しい事業にチャレンジしていくことが重要です。これはアップルなどを念頭に置けばイメージしやすいと思います。

AIは既存の倫理に影響を与える存在です。それを十分に認識せずに、新しいから・話題になっているから、という理由で導入してしまうとユーザーの反発を招き、それに対する企業としてのメッセージも用意されていないために、本当はユーザーにも利益があったものかもしれないのにキャンセルせざるを得なくなってしまう。

導入発表前に、本書にあるようなチェックポイントを確認したうえで臨んでいれば、ユーザーからの意見に説明したり、場合によっては反論するなどの対応ができていたはずなのです。

―― ある意味、倫理基準を示すことで「どこまでが自分たちの顧客か」という線引きをすることにもなるわけですね。SNSなどを通じて際限なくつながる時代ではありますが、全員を満足させることもできないわけで。

しかし、AIが提供できる価値は「未来はこうなる」という予測ベースのものとなります。将来ビジョンを示しながら顧客とポジティブなコミュニケーションを取ることを日本企業は苦手としそうです。

小林 たしかにそうですね。こういう本を出しておいてあれですが(笑)、AIにおける倫理をブレイクダウンしていく過程は、社内外で価値観を衝突させながら議論を煮詰めていくような作業で、「和を以て貴しとなす」文化が根強い日本ではハードルは高いです。よく言われる多民族=多様な価値観の衝突からの合意形成を前提とする北米には後れを取ってしまうわけです。

ここで挙げたようなチェックポイントを踏まえたうえでの、日本ならではのやり方、チューニングもいずれ生まれてくるのではと思います。

1つの例として、倫理委員会が下した決定に対して、強制力を持たせるか否かや、AI倫理を巡る懸案が生じたときに倫理委員会に持ち込まれるのかを必須とするか否かなどさまざまなパラメーターがあります。これらの組み合わせ方によって結果も異なってきます。

両方を強制するのが最も強力になるのですが、それを嫌って懸案事項を委員会に上げなくなる、というリスクが大きくなります。落としどころとして、委員会の決定は社長によって覆すことができるようするなど、駆け込み寺を用意しておくといった手法もありますよね。

アメリカ型のガバナンスをガチガチに効かせる方法だけでなく、日本型の根回し文化も取り入れることはできるはずです。

―― 本書の著者は、大学教員を経て企業家になったということで、異なる組織文化でのAI倫理のような未知のものを巡る意思決定について、バランスが取れた多様な見方ができている、とも言えそうです。

私たちユーザーはAIとどうつきあっていけば良い?

―― 効率的なサービスの提供などAIによる恩恵が比較的イメージしやすい企業側と、著作物が勝手に学習されてしまうといった懸念や不利益が大きくなるユーザー側とのギャップも大きくなっていると感じます。ユーザーはAIとどうつきあっていくべきなのでしょうか?

小林 残念ながら本書は実務書としてAIを利用する企業側の取り組みについて述べられているので、ユーザー側についてのお話は出てこないのです。

ただ、「いずれAIに学習させるデータが枯渇する」という指摘もあるなか、競争に躍起になっている企業側の倫理に期待しているだけではまずいことになるはずです。ましてや「学習禁止」を唱えるだけでは実効性がない。イーロン・マスク氏のような人物も出てくるくらいですからね(笑)

Grok 🥰 pic.twitter.com/bF1j6yUcga

— Elon Musk (@elonmusk) December 5, 2023

小林 まず、オンラインに公開したコンテンツはAIによる学習も含めて、どこかで使われるものだという前提に立つべきでしょう。そのうえで、どう行動すれば良いかといえば、先ほどのCLIP STUDIO PAINTの例のように、巧拙はあっても「ユーザーと向き合う」ことを志向する企業のプラットフォームを積極的に使うべきです。

そのためには規約などでユーザーが投稿したデータをどのように扱うのか(学習や模倣が起こった場合にどのように対処してくれるのか)を確認していく必要があります。

プラットフォームの側もユーザーからその観点によって取捨選択されるのだ、という緊張感のなかで事業運営されれば、安易な方向には向かいにくくなるでしょう。逆に言えば、ユーザーが声をあげていく必要があるでしょう。

創造する生成AIが出現したとき、クリエイターの価値は?

―― その通りだと思います。あとは将棋の世界でAIの活用が進んでいるように、創作も含めたユーザーの可能性を広げるものなんだ、という転換がどこかで起こってほしいですね。

小林 AIによる変化を前提としてクリエイターがどう生き残るかにも通じる話です。オンラインでの作品発表とは別に、ライブドローイングやインスタレーションなどへの対応も重要になるでしょう。

「作品があるその空間に鑑賞者がいること自体がアートである」という指摘は昔からあったわけですが、AIが介在できない場でのパフォーマンスが問われるようになってくると思います。

とは言え、ではライブパフォーマンスを得意としないクリエイターは淘汰されてしまうのか、という反論はあるかもしれません。

音楽もかつては宮廷音楽のようにパトロンがいないと成立しない芸術だったものが、現在ではDTMのように誰もが音楽を作ったり、発表できるようになったのに、ここに来てまたライブができないとダメなのかと。

現在のAIは、過去データの学習からの生成が中心となっているので、独自性・創造性に乏しいと評価されていますが、いずれはそれらを発揮するようになってくるはずです。もう一段、シンギュラリティが控えていると考えたほうが良いでしょう。

だとすると、やはりAIにはない身体性・空間性といったものを追求していくしかないのでは、と思いますね。

―― いずれにせよ、「学習されるのは嫌だ」からは脱却しなければなりませんね。

生成AIには「作者の物語性」がない

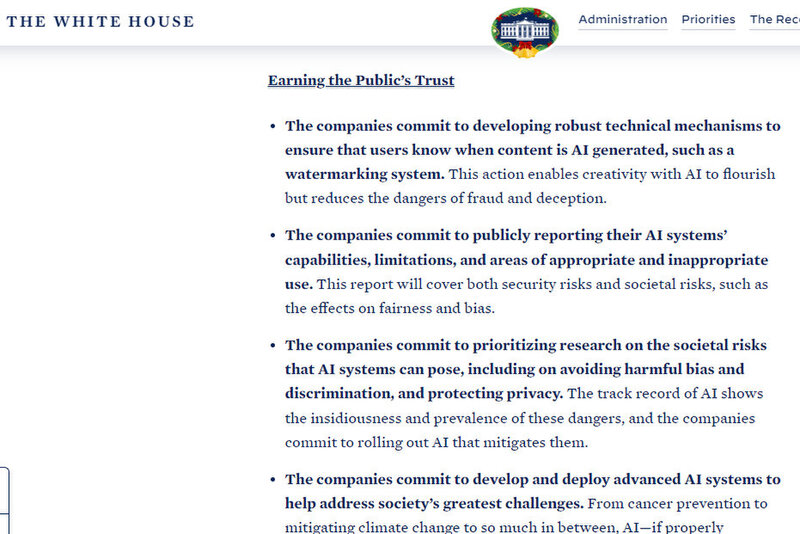

小林 生成AIによって生み出されたコンテンツにはデジタル透かしを入れて判別できるよう規制する、という方向の議論が進んでいます。仮にそれが普及すれば、逆に人間が生み出したものの価値が高まるという可能性もあるでしょう。

その価値はAIの説明可能性という話ともリンクしますが、作者はなぜ/どのようにその作品を生み出したのか、という物語性を伴ったものになるはずです。

企業の倫理、ストラクチャーとコンテンツの関係は、個人にも適用できるものですから、たとえば「AIに真似されたくない」というのを倫理ストラクチャーの中心に置くのであれば、真似されないようなコンテンツとはどのようなものなのか、をブレイクダウンしていく必要があります。

逆に「真似されても良い」とするならば、商業利用はNGとするといった戦略が考え得るでしょう。

―― ヒトはほかの動物と違って物語として世界を認識する生き物である、と言われますが、まさにその点がAIに対する優位性と言えるかもしれませんね。虚実織り交ぜて物語を語ることができて、他者もそこに価値を感じ取ることができるというのは、AIとの差別化を考えるうえでも重要だと感じました。

小林 映画『君たちはどう生きるか』への感想、考察などもまさにそうですよね。宮﨑駿監督のライフヒストリーから私たちは物語を読み取ろうとするし、そこに喜びも感じるわけです。

将来AIが長編映画も作れるようになっても、学習したデータの特徴、言わば上澄みだけをすくい取ったものになりますから、そこから物語を読み取ることはあまり楽しいものにはならないでしょう。人間が作ったからこその感動というのはやはりあると思うのです。

◆

よく指摘されることではあるが、19世紀に写真が発明されたときも「絵画を巡る文化や経済を破壊するのではないか」という混乱が広がった。もちろん影響はあったものの、21世紀の現在でも写真と絵画は共存している。

AIによるインパクトも決して小さなものではないが、私たち人間と私たちが生み出すものとの共存が模索されることになるだろう。そこで重要になってくるのが心構えに留まらない実践的な「倫理」なのだ。

〈前編はこちら〉

■Amazon.co.jpで購入

AIの倫理リスクをどうとらえるかリード・ブラックマン、小林啓倫白揚社

この記事に関連するニュース

-

ChatGPTよりも安全を掲げる"憲法AI"の可能性 AIをトレーニングし安全・無害・誠実な出力を行う

東洋経済オンライン / 2024年7月1日 11時30分

-

AIはアニメ制作現場でどこまで活用できるのか?スタジオジブリ作品にも参加する泉津井陽一氏×AIHUB 新井モノ氏の対談から浮き彫りになった現場のニーズ

アニメ!アニメ! / 2024年6月29日 15時0分

-

AIに難しい「時間的な動き」の理解、動画-自然言語モデルで目指す突破口

ASCII.jp / 2024年6月13日 10時0分

-

NetApp、Lenovoと生成AIのために最適化されたコンバージド インフラストラクチャ ソリューションを発表

PR TIMES / 2024年6月7日 13時45分

-

NetApp、AI時代に対応したユニファイド データ ストレージを発表

PR TIMES / 2024年6月7日 13時15分

ランキング

-

1「コレのせいやったんか」 最近スマホが重い → “とんでもない理由”が判明……!? 「自分もやってた」「4年以上経ちました」と猛者たち集結

ねとらぼ / 2024年7月5日 16時0分

-

2清春、27年前にブチギレた“因縁の大物芸人”と対峙 トガっていた時期に頭たたかれ“殺しのリスト”入りへ「テレビナメるな」「パーンって」

ねとらぼ / 2024年7月5日 16時5分

-

3ランサムウェア被害、報告続出 イセトーサイバー攻撃で今わかっていること(7月5日時点)

ASCII.jp / 2024年7月5日 15時45分

-

4VTuber・犬山たまき所属事務所、誹謗中傷した人物との間で和解成立―当初「示談金の支払などは行わない」と回答するも訴訟提起で一転

インサイド / 2024年7月5日 16時55分

-

5Google検索も不要に? 検索AI「Perplexity」がスゴすぎてちょっと怖い

ITmedia NEWS / 2024年7月5日 19時16分

記事ミッション中・・・

記事にリアクションする

![]()

記事ミッション中・・・

記事にリアクションする

エラーが発生しました

ページを再読み込みして

ください