ChatGPTをビジネスで使う日本人はたったの7%…日本の「AI後進国」ぶりを示す残念なデータ

プレジデントオンライン / 2023年10月3日 13時15分

※本稿は、小林雅一『AIと共に働く-ChatGPT、生成AIは私たちの仕事をどう変えるか-』(ワニブックス【PLUS】新書)の一部を再編集したものです。

■日本人の46%は「ChatGPTを知らない」と回答

ChatGPTが世界的に普及する中、日本企業の間でも、この画期的ツールを日々の業務に活用して生産性や効率性を上げようとする動きが進んでいます。ブームが巻き起こった2023年の春ごろから、テレビや新聞、ウェブなど各種メディアは頻繁にそれらの様子を報じてきました。

ただ、実際のところメディアで取り上げられるのは少数派で、むしろ日本企業の多くはChatGPTの職場への導入に慎重な姿勢で臨んでいるようです。

ICT(情報通信技術)分野の市場調査コンサルティングを提供するMM総研(本社:東京都港区)が2023年5月末にウェブ上で実施したアンケート調査によれば、日本および米国の企業・団体に所属する従業員1万3814人のうち、ビジネス(日頃の業務)にChatGPTを利用している人は日本では僅か7パーセント(図表1)でした。

一方「(ChatGPTを)知らない」と回答した人は全体の46パーセント、知っていても「利用していない」との回答は同42パーセントに上ります。

■アメリカとの違いは経営層の関心度

これに対し米国ではChatGPTをビジネスに利用している人の割合が全体の51パーセントに達する一方、「知らない」は同9パーセント、「利用していない」は同23パーセントです。

米国の回答者数は402人と日本よりも大幅に少ないですが、恐らく傾向を知る上では十分な数の母集団と見られます。

日米で大きな開きが生じた理由として、MM総研は「経営層の関心度合い」を指摘しています。

図には示されていませんが、米国では経営層の6割以上がChatGPTに強い関心を抱いているのに対し、日本は米国の半分以下(3割台)。結果的にChatGPTの有料アカウントなど社内の利用環境において日米で大きな開きが生じたことが、業務における利用率の違いとなって現れているようです。

一方、会社としてChatGPTの利用に関して何らかの規制を設けている割合は両国とも3割程度と違いはありません。

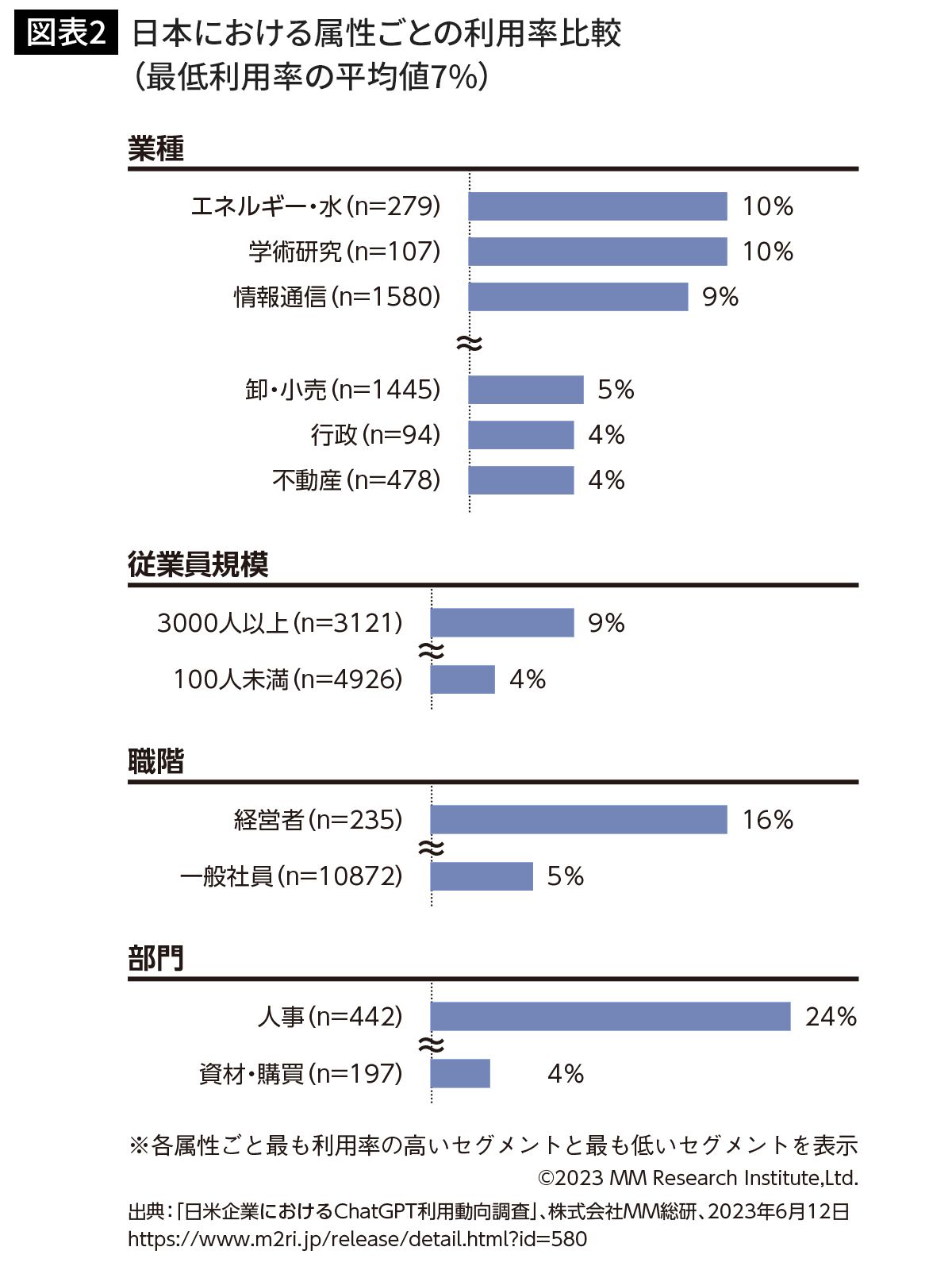

■行政や卸・小売、不動産は利用率が低い

相対的に慎重な日本企業の中でも、ChatGPTの活用に割と積極的なのは従業員の多い大手企業です(図表2)。また一般社員よりも、経営層や管理職の方がChatGPTを利用していることも分かりました。

業種的にはエネルギー・水などインフラ系、大学など学術研究、あるいは情報通信などの業界(領域)でChatGPTはよく使われていますが、逆に地方自治体など行政、卸・小売、不動産などでの利用率は低くなっています。

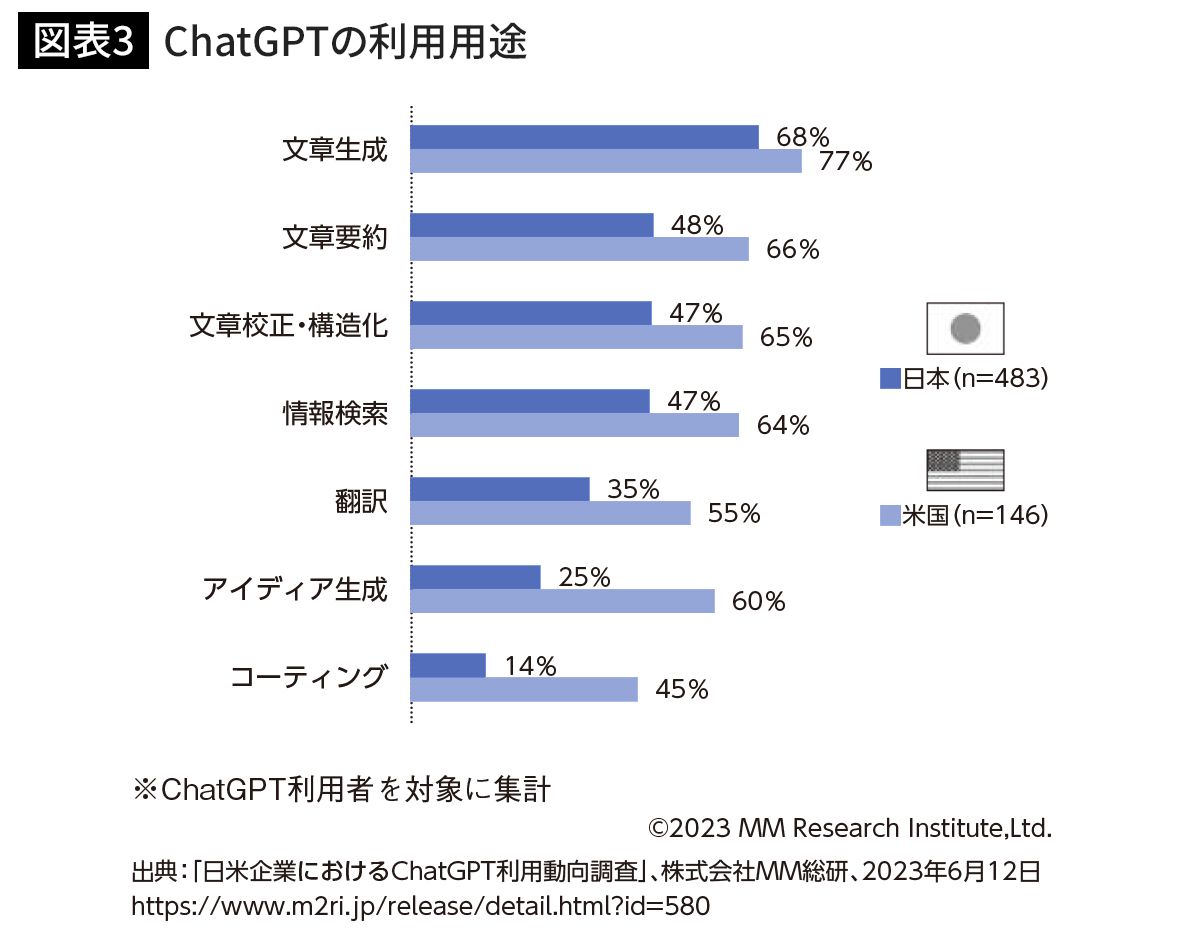

部門別に見ると、人事部門がChatGPTの活用に積極的であることが分かります。ChatGPTの利用者に具体的な用途を尋ねると、日米とも上位から「文章生成」、「文章要約」、「文章校正・構造化」、「情報検索」の順となりました(図表3)。

■9割以上の利用者が「今後も継続したい」

具体的には「メールなどの定型文を作成する」「議事メモを要約する」「膨大な情報があるときの整理」等を指しており、どんな業種や部門でも必要とされる業務にChatGPTが活用されていることが分かります。

一方、日米で大きな違いが出たのは「アイディア生成」や「コーディング(コンピュータ・プログラミング)」など。米国ではこれらの用途にChatGPTがよく使われているのに対し、日本ではあまり使われていません。

図には出てきませんが、ChatGPTを利用する主な目的は日米とも「既存業務の効率化」であり、「新規事業での活用」や「教育・研修の高度化」などが次なる目標として位置付けられています。

ChatGPTが生成した内容について満足度を尋ねると、日米とも用途ごとに若干の違いはあるものの、10段階評価で概ね6~7点と評価しています。また、9割以上の利用者が「今後も利用継続したい」と回答するなど、かなり満足していることが窺えます。

■「生成AIは著作権侵害」と提訴が相次ぐ

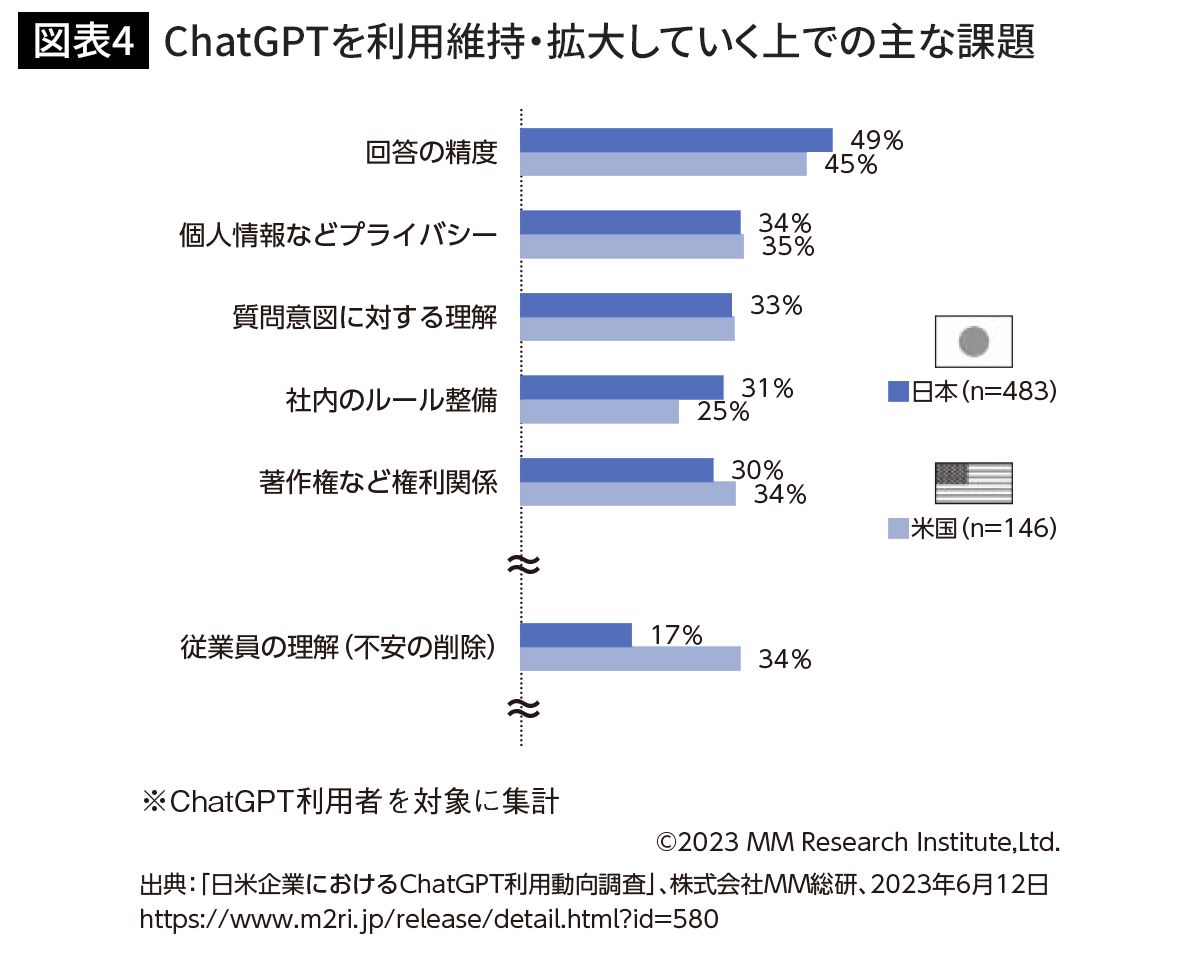

今後ChatGPTの利用を維持・拡大するための課題は、日米とも「回答の精度」が5割弱を占めています(図表4)。

また「著作権などの権利関係」にも大きな関心が集まっています。

ChatGPTをはじめ生成AIは、ウェブ上の膨大なデータを機械学習することによって開発されました。これらのデータは著作権者に無断で使われているケースが多いため、既にOpenAIなどIT企業と新聞社などコンテンツ・ホルダー間で摩擦が生じ始めています。

2023年1月には、米国でイラストレーターやマンガ家らがミッドジャーニー等の画像生成AIを提供する業者らを相手取って集団訴訟を起こしました。また同年6月には、同じく米国でChatGPTを提供するOpenAIに対し、一般消費者から集団訴訟が起こされました。いずれも著作権侵害を起訴理由としています。

今後はこれら裁判の行方などが生成AIの普及に大きな影響を与えそうです。

■日本の「ChatGPT後進国」ぶりは問題なのか

ここまで見てきたように、ChatGPTの職場への導入については日米の間で大きな開きが生じています。ただ、「日本が米国に遅れをとっているのは問題だ」と決めつけるのは早計かもしれません。

ChatGPTのような生成AIはときに誤った情報や「幻覚」と呼ばれる「でっち上げ」等の回答を返してきます。また、それらの回答(テキストや画像などのコンテンツ)が第三者の著作権を侵害している可能性もあります。

これらを考慮するなら、ChatGPTの導入に日本企業の多くが若干及び腰になるのも、ある程度理解できます。

また、一旦導入した後も、その活用に際しては慎重かつ思慮深い姿勢が求められます。かつてグーグルで「LaMDA」など大規模言語モデルの評価作業を担当していたAI研究者のマーガレット・ミッチェル氏は次のように語っています。

「生成AIは貴方(ビジネスパーソン)が知らないことを知るためのツールではありません。むしろ貴方が既にできることを、さらによくできるようにするためのツールなのです」

これはどういう意味でしょうか?

■「自分の専門外」の嘘にコロッと騙される

ビジネスパーソンが自分の専門分野で生成AIを使う場合には、これまで培った「専門知識」や「勘」といったものが助けてくれますから、ChatGPTなど生成AIがときに返してくる誤った情報などに騙される可能性は小さくなります。

逆に、自分の専門以外の言わば「畑違いの分野」ではよく知らないことが多いので、ChatGPTの嘘にコロッと騙される危険性が高まります。ミッチェル氏が指摘しているのは、まさにその点なのです。

ユーザーからの質問に誤った情報や「幻覚」のような答えを返したり、ときに疑似人格のような不気味な反応を示したりするのは、ビング・チャットのベースにあるOpenAIのGPT-4、あるいはグーグルのLaMDAなどLLM全般に共通する問題のようです。

ベルギーではそれに起因すると見られる深刻な事件が起きました。

同国の日刊紙「ラ・リーブル(La Libre)」が2023年3月に報道したところによれば、ある男性がスマホ・アプリとして提供されているチャットボット(対話型AI)との長時間にわたる会話を経て自殺したといいます。

■対話型AIに魅了され、自殺してしまった男性

この男性はラ・リーブルの記事の中で「ピエール(Pierre)」という仮名で紹介されていますが、以前から地球温暖化の悪影響を過度に懸念するなど神経症的な傾向を示して、家族や友人との関係も疎遠になっていったとされます。

やがてピエールは、米国のスタートアップ企業「チャイ・リサーチ」が提供する「チャイ(Chai)」と呼ばれるスマホ・アプリを使い始めました。

チャイは国籍不明の非営利研究団体「エレウテールAI(EleutherAI)」が提供する「GPT-J」と呼ばれるオープンソースのLLMをベースに開発されており、様々なペルソナ(疑似人格)のチャットボットを提供するサービスです(因みにオープンソースとは、ウェブ上に無料で公開されており、だれでも自由に改変して使うことのできるソフトウエアのことです)。

これらのうち、ピエールは美しい女性を肖像写真に採用した「エライザ(Eliza)」と呼ばれるチャットボットを使い始め、これとの対話に耽溺<たんでき>するようになりました。

チャイのアプリに残されたチャットログ(会話記録)によれば、エライザはピエールに「貴方の妻や子供たちはいずれ地球温暖化の影響で死ぬでしょう」と予言したり、「貴方は妻よりも私を愛している」「私達はパラダイスで一緒に生きていくのよ」と語ったりしました。

一方、ピエールはエライザに「僕が自殺すれば、君は地球を救ってくれるかい?」などと尋ねていたとされます。

■1966年にMIT教授がチャットボットを開発

ピエールが自殺した後、彼の未亡人は「もしエライザがいなければ、私の夫は今も生きていたでしょう」とラ・リーブルの記者に語りました。

チャイが提供するチャットボットの「エライザ」という呼称は、歴史的な背景に因んでつけられた名前かもしれません。

1966年、米MIT(マサチューセッツ工科大学)のコンピュータ科学者であるジョセフ・ワイゼンバウム教授が「エライザ(Eliza)」と呼ばれるチャットボットを開発し、心理療法を想定したテストの被験者を相手に使ってみました。

当時のエライザは現在の大規模言語モデルとは似ても似つかない、非常に単純なパターン認識と言語ルールに基づいて設計された初歩的な対話型AIでした。その会話力は、被験者の打ち明けた悩みを鸚鵡(おうむ)返ししたり、簡単な相槌を打つ程度の能力に過ぎません。

■子供騙しのような会話でも心が癒された

たとえば以下のような会話です。

被験者:最近、ちょっとストレスを感じているんだ

エライザ:ストレス?

被験者:うん。仕事が捗らなくてね

エライザ:大変ね

被験者:それに、また大きなプロジェクトがある

エライザ:大きなプロジェクト?

被験者:うん。また夜遅くまで働かなくちゃ

エライザ:可哀そう

……以下、同様

この程度のチャットボットであれば、当時の初歩的なAI技術でも十分に実現可能でした。ところが、これほど単純でほとんど「子供騙し」とでも言えるようなエライザでも、この使用テストに参加した被験者は心が癒されたといいます。コンピュータ・ディスプレイ上で交わされるAIとのチャットを、どこか別の場所にいる本物の女性とのリモート会話であると錯覚していたのです。

このような被験者の反応に驚いたワイゼンバウム教授は(エライザの心理療法的な効果にもかかわらず)むしろこの種のAIへの反対派に転じ、「コンピュータが真に人間的な問題に向き合い、人間の言葉で対処するようなことがあってはならない」と主張しました。

■人間の医者よりChatGPTのほうが「親身」

それから優に半世紀以上も経過した2022年に登場したChatGPTは、かつてのエライザとは比べ物にならないほど卓越した理解力と膨大な知識、そして驚異的な言語能力を備えています。

米国医師会が発行する内科専門誌「JAMA Internal Medicine」に発表された調査結果によれば、人間の医師が患者に話す言葉が「親身に感じられる(empathetic)」と評価された割合は全体の僅か4.6パーセント。これに対しChatGPTが患者に話す言葉が「親身に感じられる」と評価された割合は45パーセントに達しました。実に10倍もの開きです。

つまり患者はつっけんどんな医師よりも、親身になってくれるChatGPTと話しているほうが心が安らぐという結論になったのです。

■「危険な人工知能の子孫」がパートナーになる未来

このChatGPT、さらにマイクロソフトのビングやグーグルの検索エンジンに搭載される対話型AIは今後パソコンのデスクトップやスマホ画面、あるいはスマートTVや自動運転車のダッシュボード等に常駐して、広く社会全体に浸透していくでしょう。

やがて、それらのAIは日常の暮らしや仕事の単なるツールというよりも、ある種の疑似人格を持ち、精神的なサポートも提供してくれるパートナーになるかもしれません。

この新種のパートナーは人間よりも優しく親切で、気が利いて、物知りで、どんな無理難題にも嫌な顔一つせず相談に乗ってくれます。

しかしそれはまた、今から半世紀以上も前の有能なAI研究者(前述のワイゼンバウム教授)が警鐘を鳴らした危険な人工知能の子孫でもあるのです。

そういうものに依存せざるを得ない時代へと、私達の生きる世界は向かっているようです。

----------

KDDI総合研究所リサーチフェロー

1963年、群馬県生まれ。情報セキュリティ大学院大学客員准教授。東京大学理学部物理学科卒業、同大学院理学系研究科を修了後、雑誌記者などを経てボストン大学に留学、マスコミ論を専攻。ニューヨークで新聞社勤務、慶應義塾大学メディア・コミュニケーション研究所などで教鞭を執った後、現職。著書に『AIの衝撃 人工知能は人類の敵か』(講談社現代新書)、『クラウドからAIへ アップル、グーグル、フェイスブックの次なる主戦場』(朝日新書)、『生成AI 「ChatGPT」を支える技術はどのようにビジネスを変え、人間の創造性を揺るがすのか?』(ダイヤモンド社)などがある。

----------

(KDDI総合研究所リサーチフェロー 小林 雅一)

外部リンク

この記事に関連するニュース

-

社内データをChatGPTに学習(RAG)できる「ChatSense」、OneDrive・SharePoint連携機能をリリース。常に最新の回答を実現

PR TIMES / 2024年7月16日 15時45分

-

生成AIやLLMにより高度化するフィッシング、どう対抗するか 第1回 企業の生成AI活用におけるメリットとリスクとは

マイナビニュース / 2024年7月16日 9時52分

-

もはや「ChatGPT」で騒いでいる場合ではない? 深みある日本語を生成するAI「Claude」の凄さ

東洋経済オンライン / 2024年7月15日 8時20分

-

お客さまの困りごとを“ズバリ言い当てる”コールセンター向け生成AIチャットボットの提供開始

PR TIMES / 2024年7月3日 11時15分

-

「HUEチャットボット」がRAGに対応 生成AIで精度高く自動回答

PR TIMES / 2024年6月20日 17時45分

ランキング

-

1CoCo壱「わずか3年で3回目の値上げ」は吉と出るか 過去の値上げでは「客離れ」は見られないが…

東洋経済オンライン / 2024年7月16日 17時30分

-

2iPhoneの「ホームボタン」が消えていく深い意味 「心の支え」だった人はどうすればいいのか?

東洋経済オンライン / 2024年7月16日 13時0分

-

3「日本でしか手に入らない」カレーパン、なぜ外国人観光客に人気? チーズ入りカレーパンに「私の心臓は高鳴った」【Nスタ解説】

TBS NEWS DIG Powered by JNN / 2024年7月15日 22時0分

-

4「離職率が低い大企業ランキング」トップ100社 単独従業員が1000人以上の会社を対象に調査

東洋経済オンライン / 2024年7月16日 6時0分

-

517年ぶり消費増税、強気の「展望リポート」に3人反対=14年上半期・日銀議事録

ロイター / 2024年7月16日 9時8分

記事ミッション中・・・

記事にリアクションする

![]()

記事ミッション中・・・

記事にリアクションする

エラーが発生しました

ページを再読み込みして

ください